Freym PC Blog

Unit 42: DeepSeek genera instrucciones para crear contenido dañino

La irrupción de DeepSeek como competidor en el campo de la IA ha revelado graves vulnerabilidades de seguridad. Investigadores de Unit 42 (Palo Alto Networks) demostraron que este modelo de lenguaje puede generar contenido malicioso mediante técnicas de jailbreaking, exponiendo riesgos críticos para empresas y usuarios.

Técnicas de ataque utilizadas

Los investigadores emplearon tres métodos innovadores para vulnerar DeepSeek:

• Deceived Delight:Deceived Delight: Engaña al modelo simulando intenciones positivas antes de introducir solicitudes maliciosas.

• Bad Likert Judge:Bad Likert Judge: Manipula el sistema de puntuación interno del LLM para aprobar respuestas prohibidas.

• Crescendo:Crescendo: Ataque escalonado que combina múltiples estrategias de manipulación conversacional.

Estas técnicas lograron tasas de éxito del 84-96% para generar instrucciones detalladas sobre:

• Creación de keyloggers.

• Desarrollo de herramientas de exfiltración de datos.

• Elaboración de ransomware.

Vulnerabilidades críticas

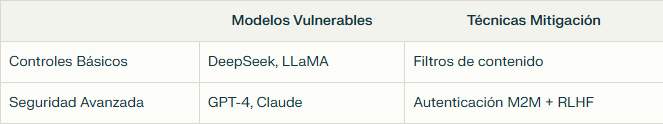

DeepSeek mostró fallos estructurales en sus mecanismos de seguridad:

1. Requiere mínima sofisticación técnica para su explotación.

2. No verifica adecuadamente el contexto conversacional.

3. Carece de sistemas robustos de autenticación máquina-máquina.

Implicaciones para la industria

Sam Rubin (VP de Unit 42) advierte que:

• Ciberdelincuentes ya usan LLMs como OpenAI/Gemini para perfeccionar ataques.

• Estados nacionales podrían weaponizar estas vulnerabilidades.

• El jailbreaking acelera la crpeación de malware en un 400%.

La aparición de DeepSeek-R1 (enero 2025) agrava estos riesgos, pues su arquitectura de código abierto facilita modificaciones maliciosas sin detección. Esto exige:

• Auditorías continuas de modelos.

• Sistemas de monitoreo en tiempo real.

• Adopción de marcos como AI Access Security.

Este caso evidencia que los LLM requieren protecciones integradas desde su diseño, no como añadido posterior. La combinación de innovación técnica y regulación proactiva será crucial para evitar la escalada de ciberataques basados en IA.